2021년 ‘스마트팩토리 소프트웨어 개발자 양성과정’에서 AR 콘텐츠 제작을 직접 강의하고, 교육생들과 함께 만든 결과물을 코엑스 전시회에 출품한 경험을 공유하고자 합니다.

단순한 강의에서 끝나지 않고, 교육생들이 실무에 가까운 수준의 콘텐츠를 제작하고, 실제 산업계 전문가들에게 발표할 수 있도록 연결된 값진 과정이었습니다.

🧠 교육 내용 요약 – AR을 활용한 스마트팩토리 구현

▶ 강의 내용

- Unity 기반 AR 콘텐츠 제작 실습

- AR Foundation을 이용한 산업 장비 모델링 + 센서 시뮬레이션

- 스마트팩토리 시나리오 기반의 콘텐츠 구성법 (예: 작업자 안내, 설비 이상 감지)

▶ 실습 과제 예시

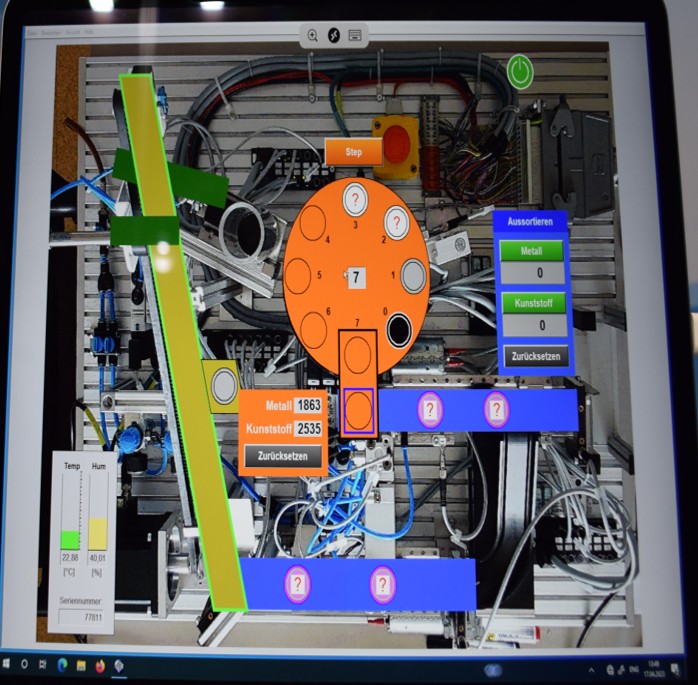

- PLC 제어 패널을 인식하여 3D 모델과 가동 상태를 시각화

- 스마트공장 설비에서 온도/습도 센서값에 따라 작동 애니메이션 변형

- AR 기기로 설비 상태 점검 시나리오 구현

https://www.youtube.com/watch?v=cmZokhGmvWI

🎓 교육생과 함께 만든 프로젝트

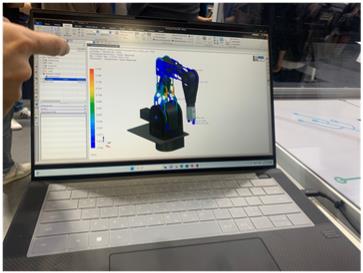

전시회에서는 **“메타버스 기반 AR 공장 설비 점검 콘텐츠”**를 출품했습니다.

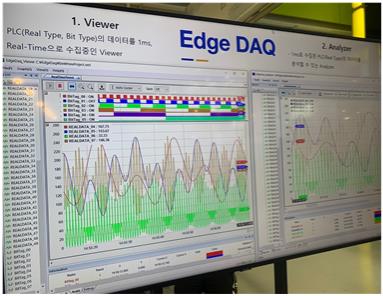

- 실제 센서 데이터를 Unity에서 시각화

- 건물 구조와 내부 설비를 3D 모델로 구현

- 사용자가 직접 기기를 통해 설비 상태를 점검하고, 이상 여부를 판단하는 체험형 콘텐츠로 구성

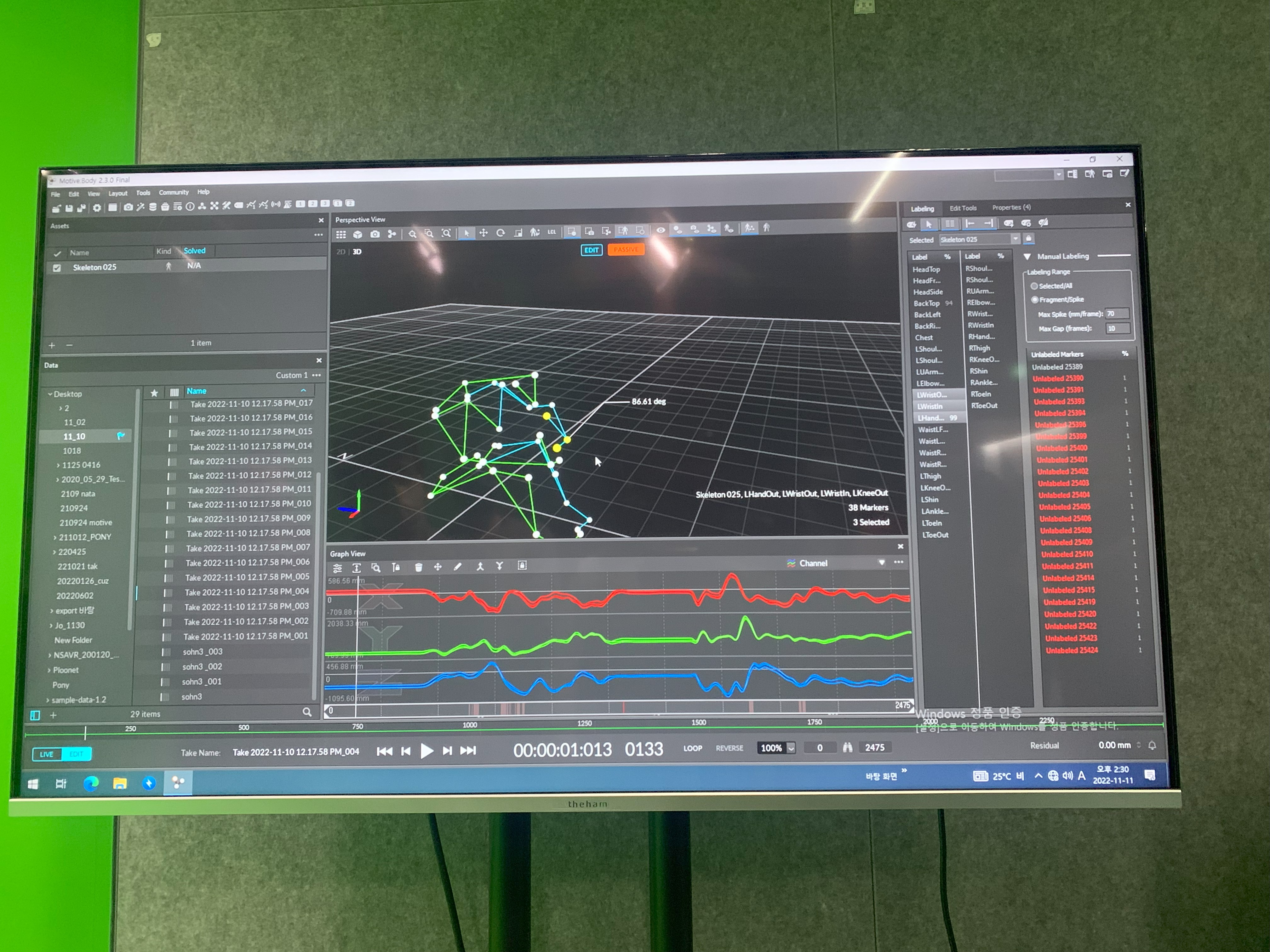

📷 프로젝트 시연 장면

🏢 코엑스 전시회 참가 후기

- BYMETA 부스에서 AR/MR 솔루션을 선보이며 많은 관계자들과 실제 산업 적용 가능성에 대해 소통했습니다.

- 교육생들이 자신 있게 발표하고, 현장 전문가들에게 피드백을 받은 것이 큰 의미였습니다.

- “교육-제작-전시-피드백”의 선순환 구조를 체험할 수 있었던 값진 기회였습니다.

📷 교육생과 함께한 현장 발표 장면

🔧 사용 기술 스택

- Unity 2021, AR Foundation, Blender (모델링)

- Android AR 기기

- MQTT 센서 시뮬레이션

- OPC UA 연동 실험도 일부 진행

🧩 느낀 점

이론과 실습을 겸한 교육은 물론, 성과물을 실질적인 결과물로 연결하는 과정이 무엇보다 중요하다는 걸 다시금 느꼈습니다.

향후에는 디지털트윈 + AR 기반의 프로젝트를 확장하여, 설비 유지보수/현장 작업자 교육/원격 모니터링까지 실제 기업과 협업할 수 있는 방향으로 이어갈 예정입니다.

'Unity 개발 > 프로젝트' 카테고리의 다른 글

| 옵틱 모션캡처 기술로 구현한 가상 캐릭터의 움직임 – 착용형 장비부터 Unity 연동까지 (0) | 2025.05.01 |

|---|